|

Главная |

Катастрофическаязабывчивость

|

из

5.00

|

Глубокиенейронныесетивнастоящеевремяявляютсянаиболееуспешнымметодоммашинногообучениядлярешениямножествазадач,включаяпереводтекстов,классификациюизображенийиформированиеизображений.Темнеменее,они,какправило,предназначеныдляизучениянесколькихзадач,толькоеслиданныепредставленыкрупнойобъединеннойвыборкой.

Померетогокаксетьобучаетсяпоконкретнойзадаче,еепараметрыадаптируютсядлярешенияэтойзадачи.Когдавводитсяноваязадача,новыеадаптациипереписываютзнания,которыеранееприобреланейроннаясеть.

Работавдинамическиизменяющихсясредах(например,вфинансовых)сложнадлянейронныхсетей.Дажееслиудалосьуспешнонатренироватьсеть,нетгарантий,чтоонанеперестанетработатьвбудущем.Финансовыерынкипостояннотрансформируются,поэтомуто,чтоработаловчера,можетстемжеуспехомперестатьработатьсегодня.Вэтойсфереисследователямилиприходитсятестироватьразнообразныеархитектурысетейивыбиратьизнихлучшую,илииспользоватьдинамическиенейронныесети.Последние«следят»заизменениямисредыиподстраиваютсвоюархитектурувсоответствиисними.ОднимизиспользуемыхвэтомслучаеалгоритмовявляетсяметодMSO(multi-swarmoptimization).

Болеетого,нейросетиобладаютопределеннойособенностью,которуюназываюткатастрофическойзабывчивостью(catastrophicforgetting).Онасводитсяктому,чтонейросетьнельзяпоследовательнообучитьнесколькимзадачам–накаждойновойобучающейвыборкевсевесанейроновбудутпереписаны,ипрошлыйопытбудет«забыт».

Этоявлениеизвестно,как«катастрофическаязабывчивость»исчитаетсяоднимизфундаментальныхограниченийнейронныхсетей.Например,искусственныйинтеллект,натренированныйнараспознаваниелюдей,несможетразличатьживотных.Дляэтогоегопридетсяпереобучить,однакоприэтомсетьлишитьсяопытараспознаваниялюдей.

1.6Метод упругого закрепления весов

Ученоесообществоужепредпринималопопыткисозданияглубокихнейронныхсетей,способныхвыполнятьсразунесколькозадач.Однакопрошлыерешениябылиилинедостаточномощными,илижетребовалибольшихвычислительныхресурсов,посколькусетиобучалисьсразунакрупнойобъединеннойвыборке(аненанесколькихпоследовательных).Такойподходнеприближалалгоритмыкпринципамработычеловеческогомозга.

Ещеестьальтернативныеархитектурынейронныхсетейдляработыстекстом,музыкойисериямидлинныхданных.Ониносятназваниерекуррентныхиимеютдолгосрочнуюикраткосрочнуюпамять,чтопозволяетпереключатьсясглобальныхпроблемналокальные(например,санализаотдельныхсловнаправиластилистикиязыкавцелом).Рекуррентныенейронныесетиимеютпамять,однакоуступаютглубокимсетямвспособностианализироватьсложныенаборыпризнаков,которыевстречаются,например,приобработкеграфики.

Человеческиймозгработаетсовсемпо-другому.Человекможетучитьсяпостепенно,приобретаянавыкипоодномуиприменяяпредыдущиезнанияприизученииновыхзадач.Отправнойточкойдляразработкиметодаупругогозакреплениявесовявляютсятеории,основанныенанейробиологии,озакреплении(консолидации)ранееприобретенныхнавыковивоспоминанийумлекопитающихичеловеческихмозгов.

Нейрофизиологивыделяютдвавидаконсолидации,которыепроисходятвмозге:системнаяконсолидацияисинаптическаяконсолидация.Системнаяконсолидация–этопроцесс,посредствомкотороговоспоминания,которыебылиприобретеныбыстроразвивающимисячастяминашегомозга,запечатленывчастимедленногообучения.Вовтороммеханизме,синаптическойконсолидации,связимеждунейронамирежепереписываются,еслиониважнывранееизученныхзадачах.Методупругогозакреплениявесовиспользуетэтотмеханизмдлярешенияпроблемыкатастрофическойзабывчивости.

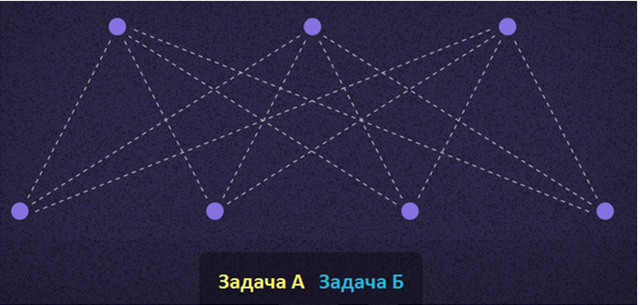

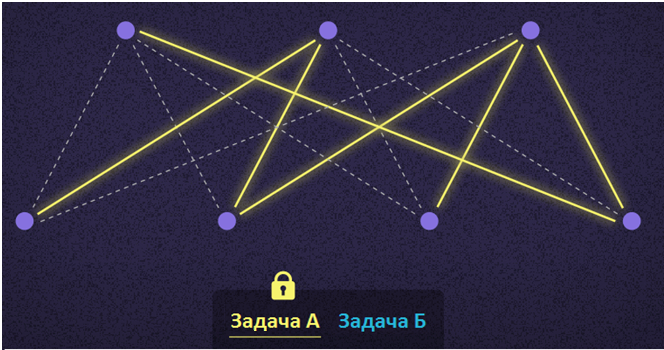

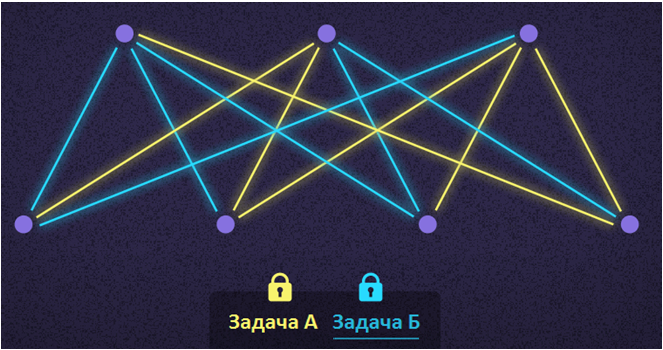

Нейроннаясетьсостоитизнесколькихсоединенийтакже,какимозг.Изучивзадачу,можновычислить,наскольковажнокаждоесоединениедляэтойзадачи.Вовремяизученияновойзадачи,каждоесоединениезащищаетсяотизмененийнавеличину,пропорциональнуюееважностидлястарыхзадач.Такимобразом,можноизучатьновуюзадачу,неперезаписываято,чтобылоизученовпредыдущейзадаче,иневызываяприэтомзначительныхвычислительныхзатрат.Нарисунках2-4схематичнопредставленпринципработыметодаупругозакреплениявесов.

Рисунок2–Иллюстрацияпроцессаобучениядлядвухзадачсиспользованиемметодаупругозакреплениявесов(EWC)

Рисунок 3 –Иллюстрацияпроцессаобучениядлядвухзадачсиспользованиемметодаупругозакреплениявесов(EWC)

Рисунок 4 –Иллюстрацияпроцессаобучениядлядвухзадачсиспользованиемметодаупругозакреплениявесов(EWC)

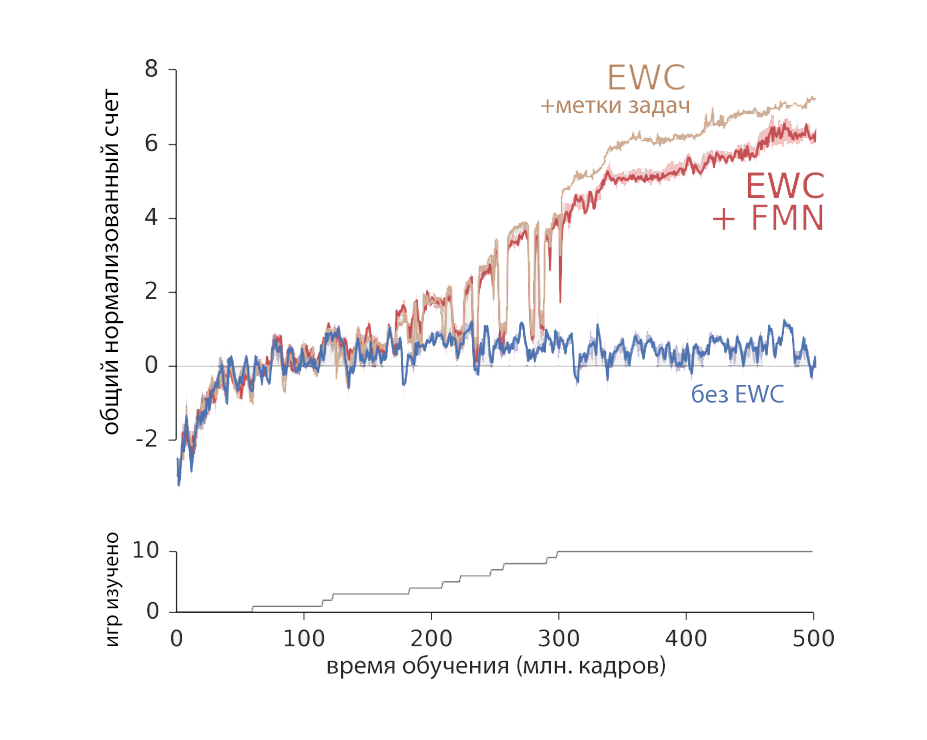

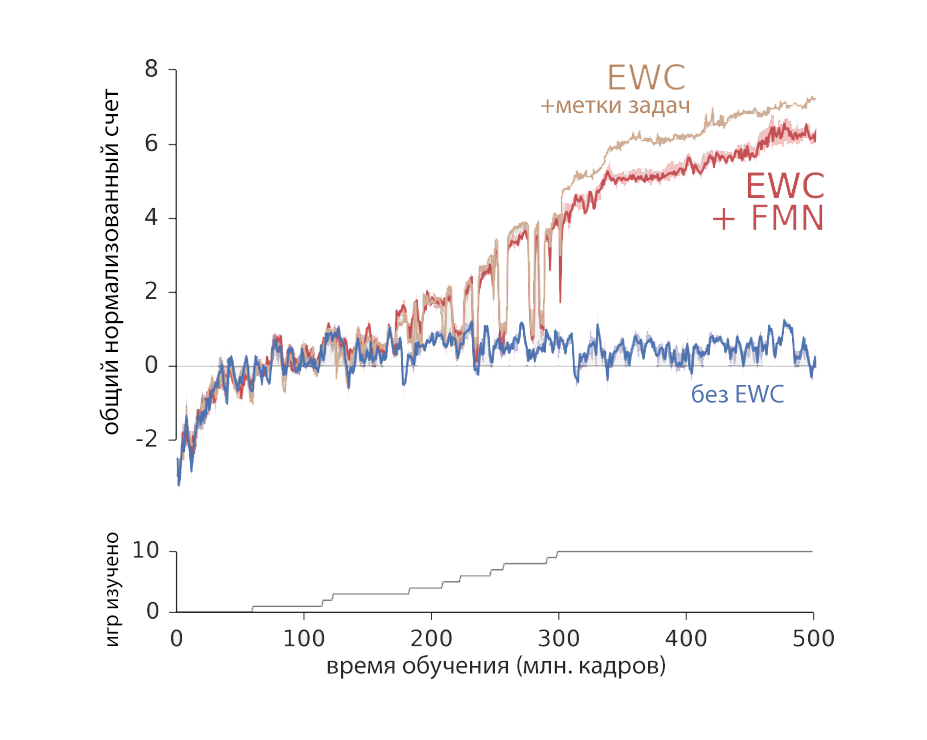

Чтобыпротестироватьданныйалгоритм,разработчикипоследовательновыставлялиагентадляигрAtari.Изучениеотдельнойигрыдляискусственногоинтеллектасамопосебеявляетсясложнойзадачей, а изучениенесколькихигрпоследовательно еще сложнее,посколькудлякаждойигрытребуетсяиндивидуальнаястратегия.Какпоказанонарисунке 5,безEWCагентбыстро забывает каждую игру после прекращениявоспроизведения(синий график).Этоозначает,чтоагент может изучить только однуигру.Однако,если использовать метод упругого закрепления весов (коричневыйикрасный графики),агентнезабывает предыдущие игры такжелегкоиможетнаучитьсяигратьвнесколькоигр последовательно.

Рисунок 5 – Эффективность нейронной сети в трех играх последовательно

Сегоднякомпьютерныепрограммынемогутизвлечьурокиизданныхадаптивноиврежимереальноговремени.Однако представленное выше исследование показало,чтокатастрофическая забывчивость неявляетсянепреодолимойпроблемойдлянейронныхсетей. Этоисследованиепредставляетсобой еще один шагкпрограммам,которыемогутучитьсяболее гибким и эффективным способом, приближаясь к принципам работы человеческого мозга.

ПоэтомуновоерешениеотDeepMindвперспективепозволитсоздавать интеллектуальные универсальныеалгоритмы,которыенайдутприменениевпрограммномобеспечениидлярешениязадач,требующих нелинейных преобразований.

|

из

5.00

|

Обсуждение в статье: Катастрофическаязабывчивость |

|

Обсуждений еще не было, будьте первым... ↓↓↓ |

Почему 1285321 студент выбрали МегаОбучалку...

Система поиска информации

Мобильная версия сайта

Удобная навигация

Нет шокирующей рекламы