|

Главная |

Расчёт информационных характеристик дискретного канала

|

из

5.00

|

ОТЧЕТ

О КУРСОВОМ ПРОЕКТЕ

«Расчет информационных характеристик источников сообщений, сигналов и каналов».

Руководитель КП

Н.А.Егорова

Исполнитель КП

П.А. Пивоваров

Нормоконтролер

Т.В. Щербакова

Пенза, 2007

Реферат

Пояснительная записка 27с., 8 рис., 1 табл.

СИГНАЛ, КАНАЛ, ЭНТРОПИЯ, СООБЩЕНИЕ, АНСАМБЛЬ, ИЗБЫТОЧНОСТЬ, КВАНТОВАНИЕ, ДИСКРЕТИЗАЦИЯ, ИНФОРМАЦИЯ.

Объектом исследования являются источники сообщений, сигналы и каналы, рассматриваемые с позиции теории информации.

Цель работы – получение навыков расчёта информационных характеристик источников дискретных сообщений и дискретного канала, изучение процессов согласования дискретного источника с дискретным каналом, дискретизации и квантования.

В процессе работы проводилось изучение необходимого теоретического материала и решение задач в соответствии с пунктами задания.

В результате выполнения работы были решены все задачи в соответствии с вариантом задания, получены навыки расчёта информационных характеристик источников дискретных сообщений и дискретного канала, изучены процессы согласования дискретного источника с дискретным каналом, дискретизации и квантования.

Значимость работы – ещё раз подтверждает слова К. Шеннона, «что с информацией можно обращаться почти так же, как с такими физическими величинами, как масса или энергия».

Следует ожидать, что идеи и методы теории информации, касающиеся источников сообщений, сигналов и каналов, будут успешно использоваться и в дальнейшем, особенно при создании сложных систем, объединяющих различные по целям, функциям и даже физическому воплощению подсистемы.

Содержание

Нормативные ссылки

Введение

1 Расчет информационных характеристик источников дискретных сообщений

2 Расчет информационных характеристик дискретного канала

3 Согласование дискретного источника с дискретным каналом

4 Дискретизация и квантование

Заключение

Нормативные ссылки

В настоящем отчете использованы ссылки на следующие стандарты:

- ГОСТ 1.5 – 93 Государственная система стандартизации РФ. Общие требования к построению, изложению, оформлению и содержанию стандартов.

- ГОСТ 2.105 – 95 Единая система конструкторской документации.

- ГОСТ 2.301 – 68 ЕСКД Форматы.

- ГОСТ 7.1 – 84 Система стандартов по информации, библиотечному и издательскому делу. Библиографическое описание документа. Общие требования и правила составления.

- ГОСТ 7.32 – 2001 Система стандартов по информации, библиотечному, издательскому делу. Отчёт о научно – исследовательской работе.

Введение

Эффективная организация обмена информацией приобретает всё большее значение, прежде всего как условие успешной практической деятельности людей. Объём информации, необходимой для нормального функционирования современного общества, растёт примерно пропорционально квадрату развития производительных сил. Доля рабочей силы, занятой вопросами обеспечения информацией, начинает превышать долю рабочей силы, занятой непосредственно в сфере производства.

Информация наряду с материей и энергией является первичным понятием нашего мира и поэтому в строгом смысле не может быть определена, при этом в узком практическом смысле под информацией обычно понимают совокупность сведений об окружающем мире, являющуюся объектом хранения, передачи и преобразования. Информация передаётся и хранится в виде сообщений, а изменяющийся во времени физический процесс, отражающий передаваемое сообщение называется сигналом. А система связи, являющаяся совокупностью технических средств, используемых для передачи сообщений от источника к потребителю информации.

В данной работе объектом исследования являются источники сообщений, сигналы и каналы, рассматриваемые с позиций теории информации, круг проблем которой можно охарактеризовать как исследование методов кодирования для экономного представления сообщений различных источников и для надёжной передачи сообщений по каналам связи с шумом.

В основе теории информации лежит статистическое описание источников сообщений и каналов связи, а также базирующееся на этом описание измерения количества информации между сообщениями, определяемого только вероятностными свойствами сообщения.

На основе теории информации можно ответить на вопросы о предельных возможностях, т.е. максимально достижимых характеристиках различных систем, определить в какой мере проектируемая система близка к теоретически возможной. В некоторых случаях логика рассуждений, используемая в теории информации, подсказывает путь, на котором может быть найдено конструктивное решение для реальной системы.

В данной работе основные идеи и методы теории информации были рассмотрены и практически закреплены на примере конкретных задач, составляющих четыре раздела задания.

Расчёт информационных характеристик источников дискретных сообщений

Задача № 1.38

Ансамбли событий X и Y объединены, причем вероятности совместных событий равны:  ;

;  ;

;  ;

;  ;

;  ;

;  ;

;  ;

;  .Найти: энтропии ансамблей X и Y соответственно

.Найти: энтропии ансамблей X и Y соответственно

; энтропию объединенного ансамбля

; энтропию объединенного ансамбля  ; условные энтропии ансамблей

; условные энтропии ансамблей

Решение:

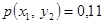

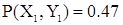

1) Известны вероятности совместных событий, и с учётом соотношения

находятся безусловные вероятности p ( xk ) и p ( yk ), которые потребуются при дальнейшем решении:

;

;

;

;

;

;

;

;

.

.

2) По формуле определения энтропии (1.4), находятся энтропии ансамблей H ( X ) и H ( Y ):

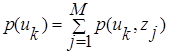

3) Для нахождения среднего количества информации, даваемое сообщением X при условии, что сообщение ансамбля Y уже известно, т.е. нахождение энтропии ансамбля H ( X , Y ), используется формула определения энтропии объединённого ансамбля:

т.о., в нашем случае H ( X , Y ) будет равна

4) Итак, была найдена энтропия объединённого ансамбля. Далее по заданию требуется определить условные энтропии ансамблей H ( X / Y ) и H ( Y / X ). Формулу условной энтропии можно получить из формулы количества информации, содержащейся Y относительно X и наоборот.

Задача № 1.66

Принимаемый сигнал может иметь амплитуду  (событие

(событие  ) или

) или  (событие

(событие  ), а также сдвиг фазы

), а также сдвиг фазы  (событие

(событие  ) или

) или  (событие

(событие  ) режимах. Вероятности совместных событий имеют следующие значения:

) режимах. Вероятности совместных событий имеют следующие значения:

;

;  ;

;  ;

;  .

.

Вычислить количество информации получаемой о фазовом сдвиге сигнала, если станет известной его амплитуда.

Решение:

Количество информации вычисляется по формуле:

Величина I(Y,X) показывает, сколько в среднем бит информации о реализации ансамбля Y дает наблюдение реализации ансамбля Z. Подставив в эту формулу в выражение для вычисления энтропии и условной энтропии:

Учитывая, что

,

,

последнее выражение можно записать в виде:

Вычисляются необходимые величины.

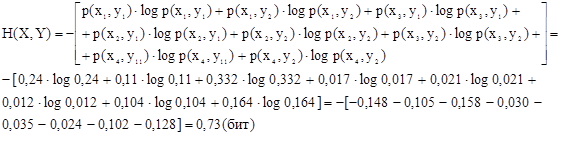

p(y1) = p(x1, y1) + p(x2, y1) = 0.47 + 0.27 = 0.74

p(y2) = p(x1, y2) + p(x2, y2) = 0.17 + 0.09 = 0.26

p(x1) = p(x1, y1) + p(x1, y2) = 0.47 + 0.17 = 0.64

p(x2) = p(x2, y1) + p(x2, y2) = 0.27 + 0.09 = 0.36

Все величины подставляются в формулу:

Задача № 1.84

Дискретный источник выбирает сообщения из ансамбля

.

.

Длительности сообщений соответственно равны: tu1=0,96 c, tu2=0,44 c, tu3=0,67 c, tu4=0,39 c. Определить производительность источника.

Решение:

Производительность источника рассчитывается по формуле,

где T – время, затрачиваемое в среднем на каждое сообщение при передаче, и определяемое в соответствии со следующим выражением:

а энтропия источника H ( U ) в соответствии с формулой (1.4) [1] равна:

Итак, производительность источника равна:

Расчёт информационных характеристик дискретного канала

Задача № 2.23

На вход дискретного симметричного канала, показанного на рисунке 2, без памяти поступают двоичные символы  и

и  с априорными вероятностями p(U1)=0,75 и p(U2)=0,25.

с априорными вероятностями p(U1)=0,75 и p(U2)=0,25.

Рисунок 2 – Дискретный симметричный канал

Переходные вероятности  в таком канале задаются соотношением

в таком канале задаются соотношением

,

,

где p=0,1 – вероятность ошибки. Определить все апостериорные вероятности  .

.

Решение:

- переходные вероятности того, что на выходе будет символ zj при условии, что на входе был символ ui.

- переходные вероятности того, что на выходе будет символ zj при условии, что на входе был символ ui.

- апостериорные вероятности того, что на входе канала имел место символ ui при условии, что на выходе наблюдается zj.

- апостериорные вероятности того, что на входе канала имел место символ ui при условии, что на выходе наблюдается zj.

По формуле Байеса:

Итак,

Задача № 2.48

Двоичный источник с равновероятными элементами имеет производительность U’=1500 бит в секунду. При передачи по каналу в среднем один из 100 символов принимается ошибочно. Определить скорость передачи инфориации по данному каналу.

Решение:

U1 Z1 “1”

U2 Z2 “0”

Рисунок 3 – Дискретный канал

Ситуация в канале характеризуется данным рисунком 3. В среднем один из 100 символов принимается ошибочно, поэтому вероятность ошибки будет составлять ро=1/100=0,01. Тогда вероятность правильного принятия будет вычисляться из следующего выражения: 1-р0=1-0,01=0,99.

Таким образом, канал описывается распределением вероятностей:

P(Z1/U1)=P(Z2/U2)=0,99

P(Z1/U2)=P(Z1/U2)=0,01

P(U1)=P(U2)=0,5- дано по условию

Скорость передачи информации вычисляется по формуле:

I’(U,Z)=H’(U)-H’(U/Z),

а энтропия будет равна 1 биту, так как

0,5log2+0,5log2=1

H’(U)=VC*H(U), где VC=1500 c-1

I’(U,Z)=H’(U)-H’(U/Z)

H’(U/Z)=VC*H(U/Z)

Условные вероятности можно найти по формуле Байеса:

H(U/Z)=-P(Z1)[P(U1/Z1)log2P(U1/Z1)+P(U2/Z1)log2P(U2/Z1)]-P(Z2)[P(U1/Z2)log2P(U1/Z2)+ P(U2/Z2)log2P(U2/Z2)]

H(U/Z)=-(0.5+0.5)(-2*0.99log(0.99)-2*0.01*log(0.01))=0.16

H’(U/Z)=VC*H(U/Z)=1500*0,16=241 (бит)

I’(U,Z)=H’(U)-H(U/Z)=1500-241=1259(бит/с)

|

из

5.00

|

Обсуждение в статье: Расчёт информационных характеристик дискретного канала |

|

Обсуждений еще не было, будьте первым... ↓↓↓ |

Почему 1285321 студент выбрали МегаОбучалку...

Система поиска информации

Мобильная версия сайта

Удобная навигация

Нет шокирующей рекламы