|

Главная |

Группировка исходных данных.

|

из

5.00

|

Применяется критерий Пирсона к сгруппированным данным. Предположим, что произведено n независимых опытов, в каждом из которых изучаемая случайная величина приняла определенное значение. Предположим, что вся числовая ось разбита на несколько непересекающихся промежутков (интервалов и полуинтервалов). Обозначим через nI количество результатов измерений (значений случайной величины), попавших в i-й промежуток. Очевидно, что ånI = n.

Отметим, что критерий c2 будет давать удовлетворительный для практических приложений результат, если:

1) количество n опытов достаточно велико, по крайней мере n³100;

2) в каждом промежутке окажется не менее 5…10 результатов измерений, т.е. ni ³5 при любом i; если количество полученных значений в отдельных промежутках мало (меньше 5), то такие промежутки следует объединить с соседними, суммируя соответствующие частоты.

Пусть концами построенного разбиения являются точки zi , где z1 < z2 < … < zi – 1 , т.е. само разбиение имеет вид

(- ¥ º z0; z1) , [ z1; z2) , [ z2; z3) , … , [ zi – 1; zi º + ¥).

После объединения соответствующих промежутков (последних двух) и замены самой левой границы разбиения на - ¥, а самой правой на + ¥ (поскольку на промежутки должна разбиваться вся числовая ось, а не только диапазон полученных в результате опыта значений), мы приходим к следующим интервальным распределениям, пригодным для непосредственного применения критерия Пирсона:

| zi –1; zi | - ¥; 6 | 6;9 | 9;12 | 12;15 | 15;18 | 18;21 |

| n i | 10 | 9 | 11 | 14 | 18 | 13 |

| 21;24 | 24;27 | 27;30 | 30;+∞ | |

| 11 | 7 | 4 | 3 |

Вычисление теоретических частот.

Критерий Пирсона основан на сравнении эмпирических (опытных) частот с теоретическими. Эмпирические частоты nI определяются по фактическим результатам наблюдений. Теоретические частоты, обозначаемые далее  , находятся с помощью равенства

, находятся с помощью равенства

= n × pi ,

= n × pi ,

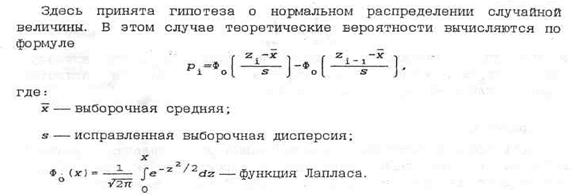

где n – количество испытаний, а pi º R (zi –1 < x < zi) - теоретическая вероятность попадания значений случайной величины в i-й промежуток (1 £ i £ 1).Теоретические вероятности вычисляются в условиях выдвинутой гипотезы о законе распределения изучаемой случайной величины.

|

|

Процедура отыскания теоретических вероятностей и частот показана в расчетной таблице: _

n = 1 0 0; а=x = 15,9 ; σ = s=7,33

| i |

Концы промежутков | Аргументы фунцкции Ф0 | Значения функции Ф0 | Pi= Ф0(u i )- Ф0(u i-1 ) | ν 1 ’ =npi | |||

| zi -1 | zi | U i- 1 = (z i-1 -x)/s | U i = (z i -x)/s | Ф0(u i-1 ) | Ф0(u i ) | |||

| 1 2 3 4 5 6 7 8 9 10 | -∞ 6 9 12 15 18 21 24 27 30 | 6 9 12 15 18 21 24 27 30 +∞ | -∞ -1,35 -0,94 -0,53 -0,12 0,29 0,70 1,11 1,51 1,92 | -1,35 -0,94 -0,53 -0,12 0,29 0,70 1,11 1,51 1,92 +∞ | -0,5000 -0,4115 -0,3264 -0,2019 -0,0478 0,1141 0,2580 0,3665 0,4345 0,4726 | -0,4115 -0,3264 -0,2019 -0,0478 0,1141 0,2580 0,3665 0,4345 0,4726 0,5000 | 0,0885 0,0851 0,1245 0,1541 0,1619 0,1439 0,1085 0,0680 0,0381 0,0274 | 8,85 8,51 12,45 15,41 16,19 14,39 10,85 6,80 3,81 2,74 |

å: 1,0000 1 0 0 ,00

Статистика c2 и вычисление ее значения по опытным данным.

Для того чтобы принять или отвергнуть гипотезу о законе распределения изучаемой случайной величины, в каждом из критериев согласия рассматривается некоторая (специальным образом подбираемая) величина, характеризующая степень расхождения теоретического (предполагаемого) и статистического распределения.

В критерии Пирсона в качестве такой меры расхождения используется величина

,

,

называемая статистикой «хи - квадрат» или статистикой Пирсона (вообще, статистикой называют любую функцию от результатов наблюдений). Ясно, что всегда c2 ³0, причем c2 = 0, тогда и только тогда, когда  при каждом i , т.е. когда все соответствующие эмпирические и теоретические частоты совпадают. Во всех остальных случаях c2 ¹ 0; при этом значение c2 тем больше, чем больше различаются эмпирические и теоретические частоты.

при каждом i , т.е. когда все соответствующие эмпирические и теоретические частоты совпадают. Во всех остальных случаях c2 ¹ 0; при этом значение c2 тем больше, чем больше различаются эмпирические и теоретические частоты.

Прежде чем рассказать о применении статистики c2 к проверке гипотезы о закон е распределения , вычислим ее значение для данного варианта; это значение, найденное по данным наблюдений и в рамках выдвинутой гипотезы, будем обозначать через c2набл..

| i | n i |

|

|

| 1 2 3 4 5 6 7 8 9 10 | 10 9 11 14 18 13 11 7 4 3 | 8,85 8,51 12,45 15,41 16,19 14,39 10,85 6,8 3,81 2,74 | 0,15 0,03 0,17 0,13 0,20 0,13 0,00 0,01 0,01 0,02 |

: 100 100 0,85

: 100 100 0,85

c 2 набл. = 0,85

5.4. Распределение статистики c2.

Случайная величина имеет c2 – распределение с r степенями свободы (r = 1; 2; 3; …), если ее плотность имеет вид

где cr – которая положительная постоянная ( cr определяется из равенства  ). Случайная величина, имеющая распределение c2 с r степенями свободы, будет обозначаться

). Случайная величина, имеющая распределение c2 с r степенями свободы, будет обозначаться  .

.

Для дальнейшего изложения важно лишь отметить, что, во – первых, распределение  определяется одним параметром – числом r степеней свободы и, во – вторых, существуют таблицы, позволяющие произвольно найти вероятность попадания значений случайной величины

определяется одним параметром – числом r степеней свободы и, во – вторых, существуют таблицы, позволяющие произвольно найти вероятность попадания значений случайной величины  в любой промежуток.

в любой промежуток.

Вернемся теперь к статистике  . Отметим, что она является случайной величиной, поскольку зависит от результатов наблюдений и, следовательно, в различных сериях опытов принимает различные, заранее не известные значения. Понятно, кроме того, закон распределения статистики

. Отметим, что она является случайной величиной, поскольку зависит от результатов наблюдений и, следовательно, в различных сериях опытов принимает различные, заранее не известные значения. Понятно, кроме того, закон распределения статистики  зависит: 1) от действительного (но неизвестного нам) закона распределения случайной величины, измерения которой осуществляются (им определяются эмпирические частоты

зависит: 1) от действительного (но неизвестного нам) закона распределения случайной величины, измерения которой осуществляются (им определяются эмпирические частоты  ) ; 2) от количества произведенных наблюдений (от числа n) и от способа разбиения числовой оси на промежутки (в частности, от числа i ); 3) от теоретического (выдвинутого в качестве гипотезы) закона распределения изучаемой случайной величины (им определяются теоретические вероятности pi и теоретические частоты

) ; 2) от количества произведенных наблюдений (от числа n) и от способа разбиения числовой оси на промежутки (в частности, от числа i ); 3) от теоретического (выдвинутого в качестве гипотезы) закона распределения изучаемой случайной величины (им определяются теоретические вероятности pi и теоретические частоты  = n × pi )

= n × pi )

Если выдвинутая гипотеза верна, то очевидно, закон распределения статистики

Если выдвинутая гипотеза верна, то очевидно, закон распределения статистики  зависти только от закона распределения изучаемой случайной величины, от числа n и от выбора промежутков разбиения. Но на самом же деле, в этом случае (благодаря мастерски подобранному Пирсоном выражению для

зависти только от закона распределения изучаемой случайной величины, от числа n и от выбора промежутков разбиения. Но на самом же деле, в этом случае (благодаря мастерски подобранному Пирсоном выражению для  ) справедливо куда более серьезное утверждение. А именно, при достаточно больших n закон распределения статистики

) справедливо куда более серьезное утверждение. А именно, при достаточно больших n закон распределения статистики  практически не зависит от закона распределения изучаемой случайной величины и ни от количества n произведенных опытов: при

практически не зависит от закона распределения изучаемой случайной величины и ни от количества n произведенных опытов: при  распределение статистики

распределение статистики  стремится к

стремится к  - распределению с r степенями свободы. Эта теорема объясняет, почему статистика Пирсона обозначается через

- распределению с r степенями свободы. Эта теорема объясняет, почему статистика Пирсона обозначается через  .

.

Если в качестве предполагаемого выбрано одно их трех основных непрерывных распределений (нормальное, показательное или равномерное), то r = i – 3, где i – количество промежутков, на которые разбита числовая ось (количество групп опытных данных). В общем случае

где  - количество параметров предполагаемого (теоретического) распределения, которые заменены вычисленными по опытным данным оценками.

- количество параметров предполагаемого (теоретического) распределения, которые заменены вычисленными по опытным данным оценками.

Т.е. в данном варианте после группировки исходных данных получаем количество промежутков разбиения i = 10,  = 2, т.к. количество параметров предполагаемого (теоретического) распределения, которые заменены вычисленными по опытным данным оценками, = 2 – это а и s для нормального распределения.

= 2, т.к. количество параметров предполагаемого (теоретического) распределения, которые заменены вычисленными по опытным данным оценками, = 2 – это а и s для нормального распределения.

Следовательно

R=i-Nпар-1=10-2-1=7

|

из

5.00

|

Обсуждение в статье: Группировка исходных данных. |

|

Обсуждений еще не было, будьте первым... ↓↓↓ |

Почему 1285321 студент выбрали МегаОбучалку...

Система поиска информации

Мобильная версия сайта

Удобная навигация

Нет шокирующей рекламы